祝贺实验室博士生齐鼎一篇论文“Towards Universal Dataset Distillation via Task-Driven Diffusion“被cvpr录用。

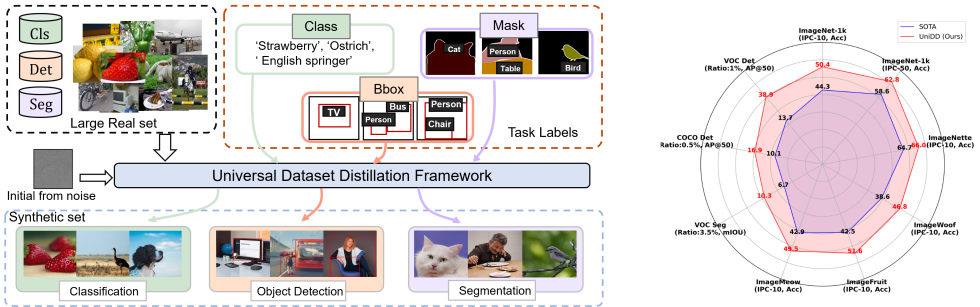

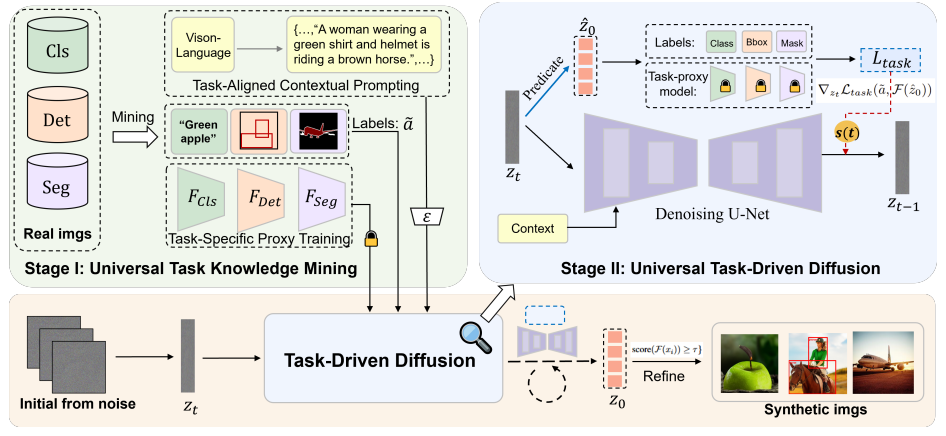

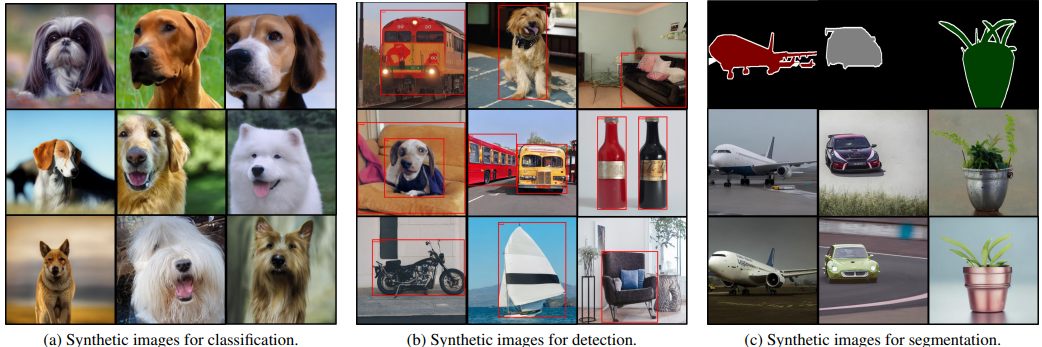

数据集蒸馏(Dataset Distillation, DD)通过将大规模数据集中的关键信息压缩为小型合成数据集,显著降低了网络训练的存储和计算开销。然而,当前研究主要集中在图像分类任务上,而对目标检测和图像分割等任务的探索相对有限。这主要受限于两大挑战:(1)任务优化异质性:现有方法通常聚焦于类别级别的信息提取,难以满足检测和分割任务对多样化特征的需求;(2)图像生成灵活性不足:现有生成方法多依赖全局更新机制,针对单类别目标进行优化,缺乏对特定目标区域的局部精细化生成能力。为解决上述问题,我们提出了一种通用数据集蒸馏框架——UniDD。该框架基于任务驱动的扩散模型,能够适应多样化的数据集蒸馏任务。UniDD的核心设计分为两个阶段:首先,在通用任务知识挖掘阶段,通过训练任务特定的代理模型,提取与任务相关的关键信息;其次,在通用任务驱动扩散阶段,利用这些代理模型引导扩散过程,生成与任务高度匹配的合成图像。我们在ImageNet-1K、Pascal VOC和MS COCO等多个基准数据集上进行了广泛实验,结果表明UniDD超越了现有最先进的方法。特别是在ImageNet-1K数据集上,当每类图像数(IPC)为10时,UniDD相较于之前的基于扩散的方法,性能提升了6.1%,同时显著降低了部署成本。这一成果为数据集蒸馏在更多样化任务中的应用提供了新的思路和方法支持。